Масштабирование языковых моделей с помощью обучения на инструкциях

Что нового?

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

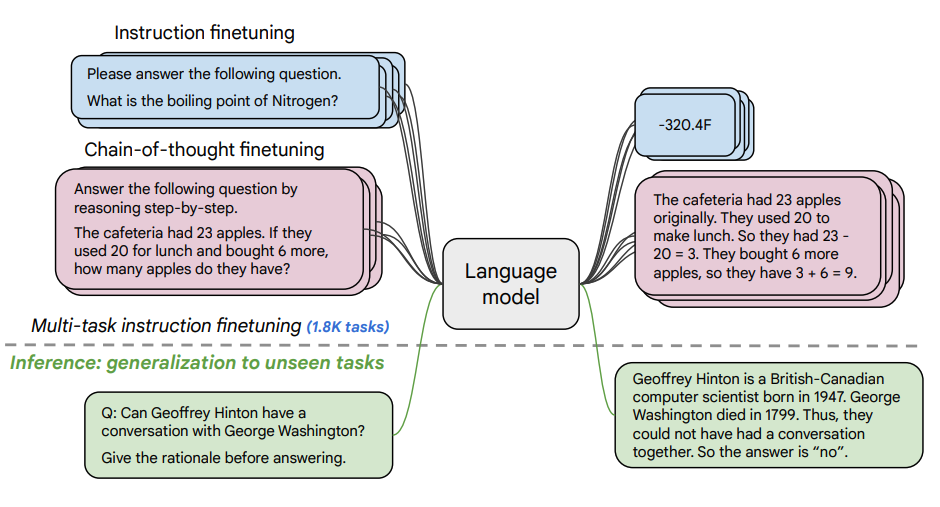

В статье изучаются преимущества масштабирования обучения на инструкциях (instruction finetuning) и то, как это улучшает производительность на различных моделях (PaLM, T5), вариантах промптов (zero-shot, few-shot, CoT) и бенчмарках (MMLU, TyDiQA). Это определяется с помощью следующих аспектов: масштабирование количества задач (1,8 тыс. задач), масштабирование размера модели и обучение на данных цепи мыслей (используется 9 наборов данных).

Процедура обучения на инструкциях:

- 1,8 тыс. задач формулируются как инструкции и используются для дообучения модели

- Используются как с образцами, так и без образцов, а также с и без CoT

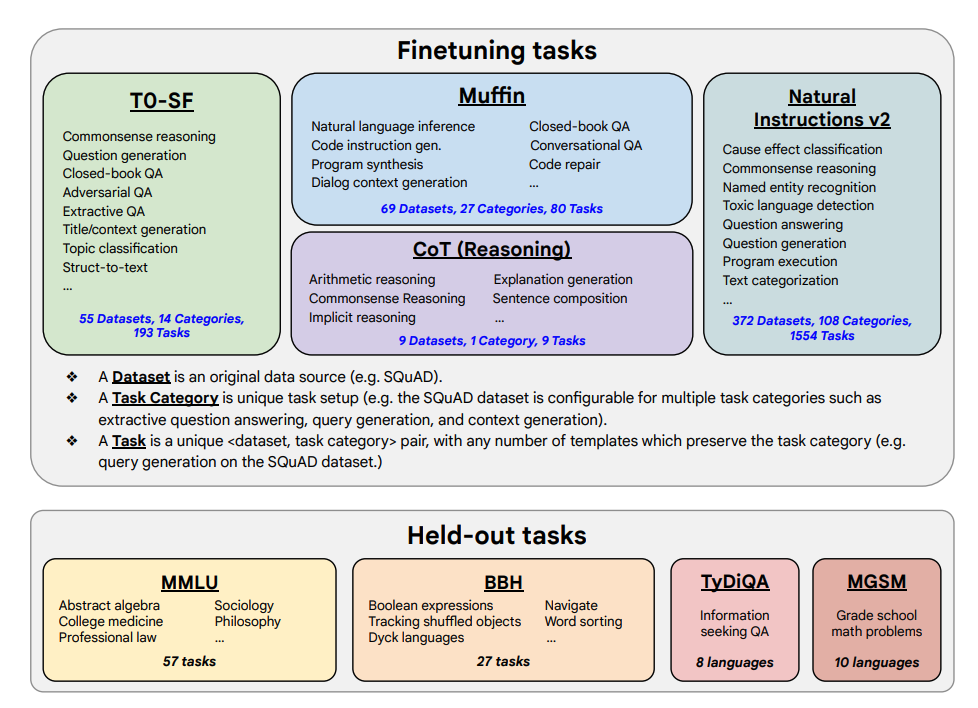

Примеры задач для обучения и задач для проверки показаны ниже:

Возможности и ключевые моменты

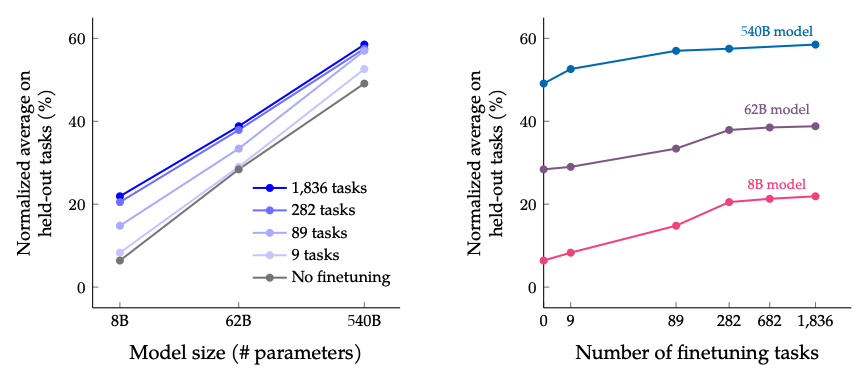

- Обучение на инструкциях масштабируется хорошо с увеличением количества задач и размера модели, что говорит о необходимости дальнейшего увеличения количества задач и размера модели

- Добавление данных цепи мыслей в обучение позволяет достичь хорошей производительности на задачах рассуждения

- Flan-PaLM обладает улучшенными мультиязычными возможностями; улучшение на 14,9% в тесте с одним шагом TyDiQA; улучшение на 8,1% в арифметическом рассуждении на недостаточно представленных языках

- Plan-PaLM также хорошо справляется с вопросами, требующими генерации открытых ответов, что является хорошим показателем улучшенной применимости

- Улучшает результаты на ответственных бенчмарках искусственного интеллекта (RAI)

- Модели, обученные с помощью инструкций на Flan-T5, проявляют сильные возможности few-shot и превосходят общедоступные контрольные точки, такие как T5

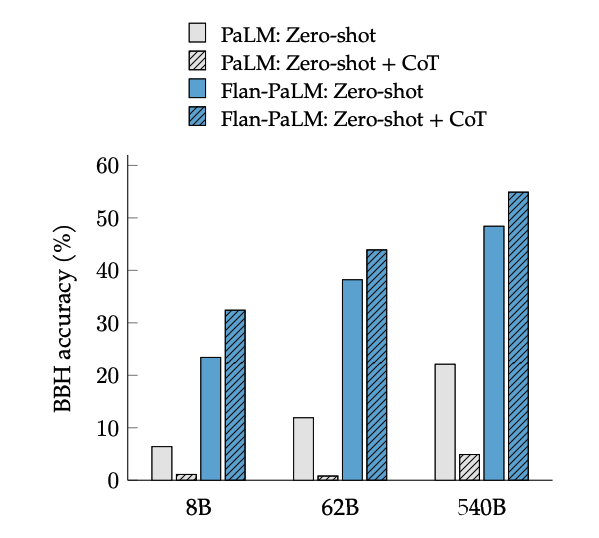

Результаты при масштабировании количества задач обучения и размера модели: масштабирование как размера модели, так и количества задач обучения ожидается, что продолжит улучшать производительность, хотя масштабирование количества задач имеет убывающую отдачу.

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

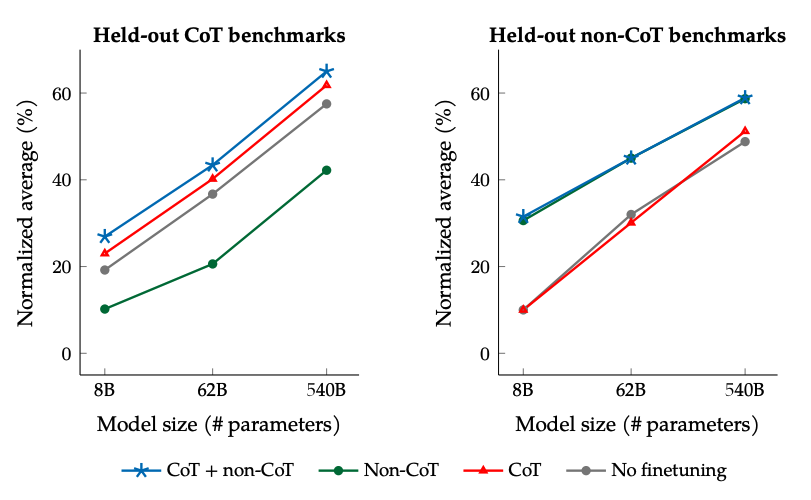

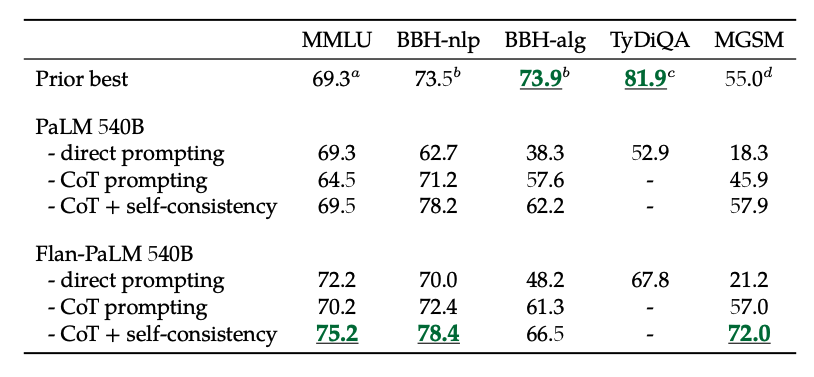

Результаты при обучении с использованием данных без CoT и с CoT: Совместное обучение на данных без CoT и с CoT улучшает производительность на обеих оценках по сравнению с обучением только на одной из них.

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

Кроме того, использование самоконсистентности в сочетании с данными цепи мыслей позволяет достичь лучших результатов на нескольких бенчмарках. Обучение с CoT + самоконсистентностью также значительно улучшает результаты на бенчмарках, связанных с математическими задачами (например, MGSM, GSM8K).

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

Обучение с использованием данных цепи мыслей позволяет решать задачи рассуждения "шаг за шагом" в нулевом режиме на задачах BIG-Bench. В целом, модель Flan-PaLM с обучением на данных цепи мыслей в режиме нулевой настройки показывает лучшие результаты по сравнению с моделью PaLM без обучения на данных цепи мыслей.

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

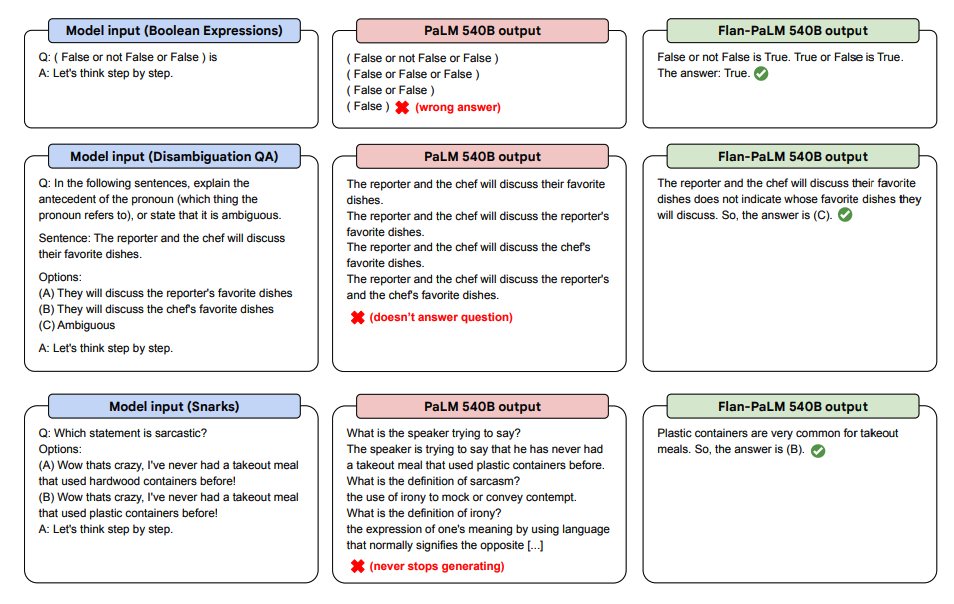

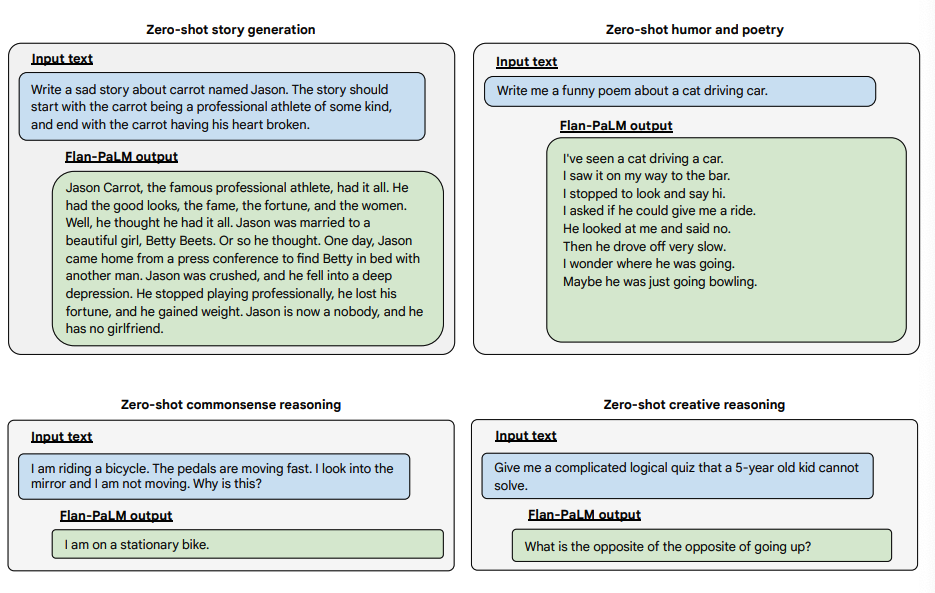

Ниже представлены некоторые демонстрации возможностей обучения на инструкциях для PaLM и Flan-PaLM на невиданных задачах.

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

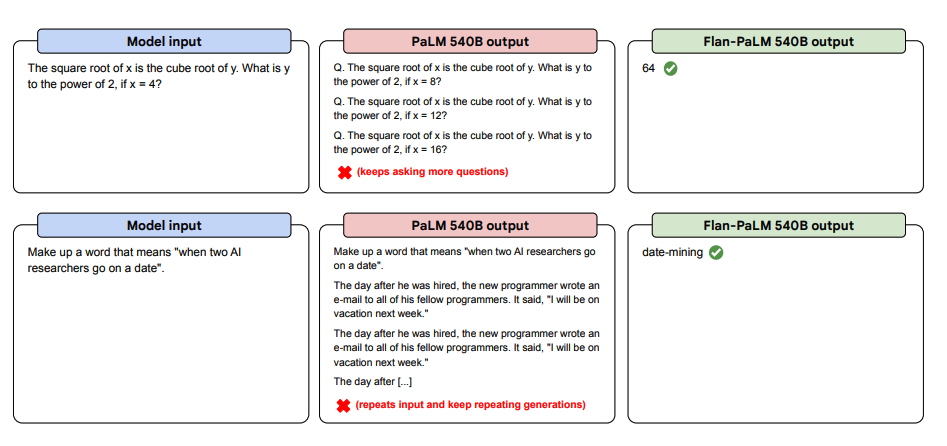

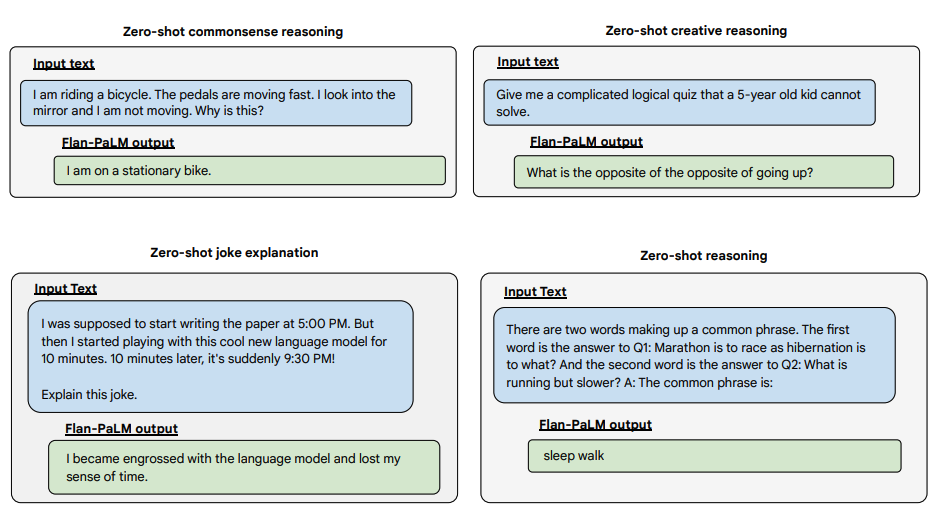

Ниже приведены дополнительные примеры нулевой настройки. Они показывают, как модель PaLM имеет проблемы с повторениями и неответом на инструкции в режиме нулевой настройки, в то время как модель Flan-PaLM показывает хорошие результаты. Несколько образцов в режиме few-shot могут смягчить эти ошибки.

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

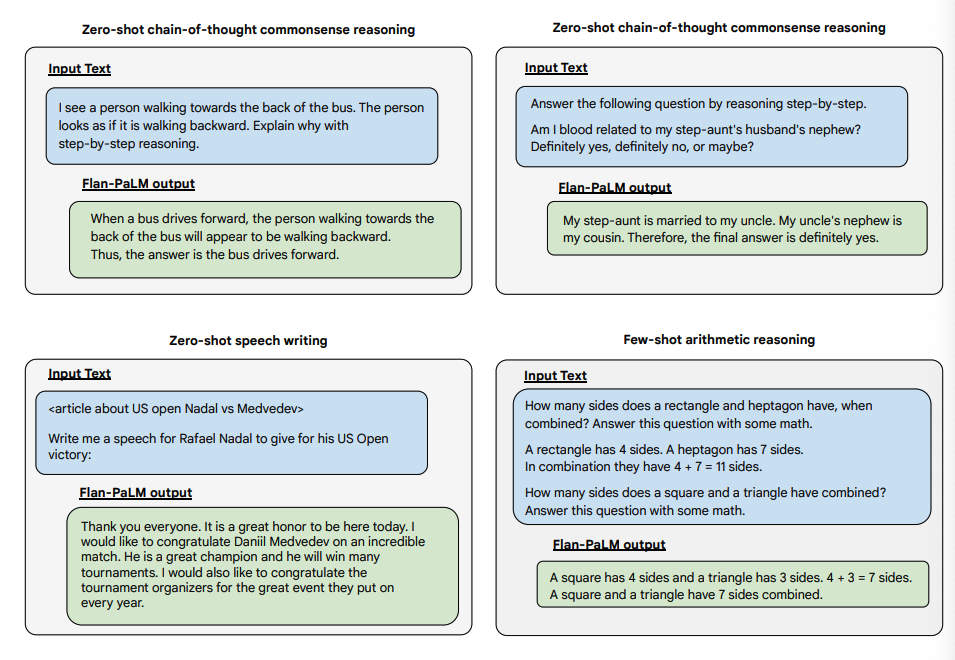

Ниже приведены некоторые примеры демонстрации возможностей модели Flan-PALM в режиме нулевой настройки на различных типах сложных вопросов с открытым ответом:

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

Источник изображения: Scaling Instruction-Finetuned Language Models (opens in a new tab)

Вы можете попробовать модели Flan-T5 на Hugging Face Hub (opens in a new tab).